‘필터버블(Filter Bubble)’은 인터넷 정보제공자가 이용자 맞춤형 정보를 제공해 필터링 된 정보만 이용자에게 도달하는 현상을 지칭한다. 미국의 시민단체 무브온(Move on)의 이사장인 엘리 프레이저(Eli Pariser)가 쓴 ‘생각 조종자들(원제 : The Filter Bubble)’에 등장하는 단어다.

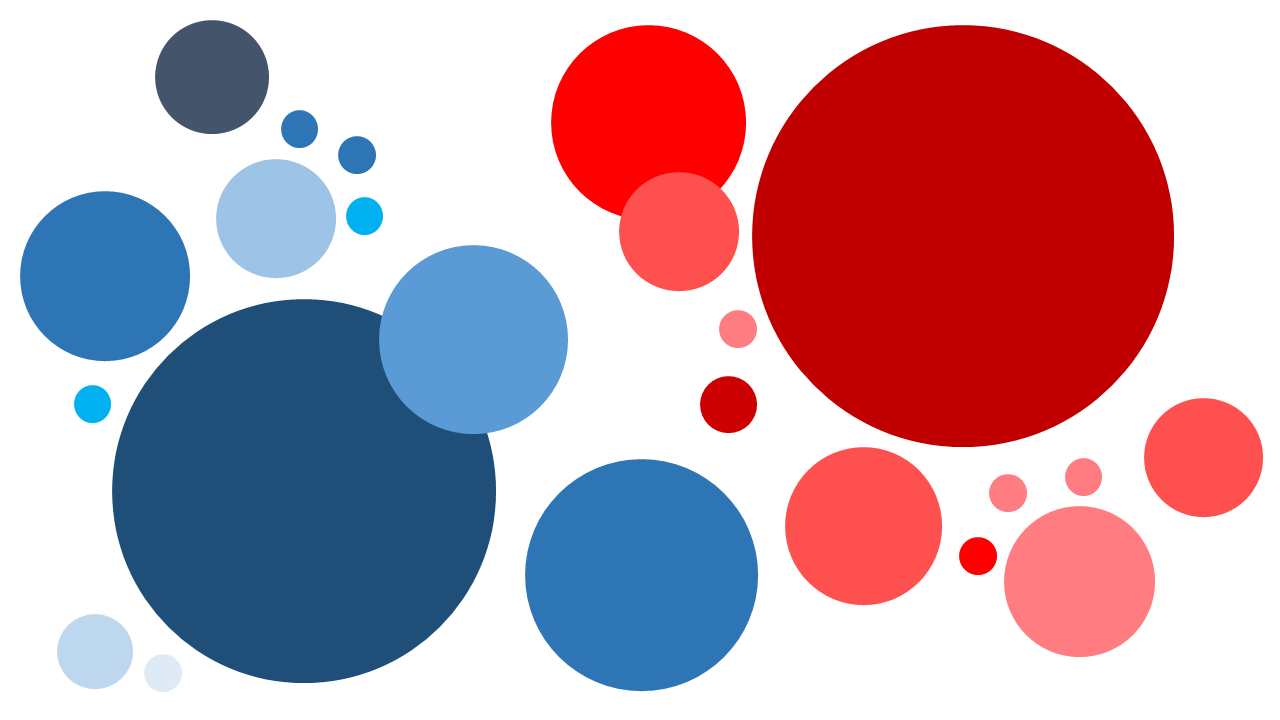

“저는 진보적 정치 성향을 가지고 있습니다. 놀랄만한 일인가요. 하지만 저는 늘 보수적 성향의 사람들을 만나려고 노력했습니다. 저는 그들이 생각하는 바를 경청하기 좋아합니다. 저는 그들이 연관된 것을 확인하기 좋아합니다. 저는 이것저것 배우는 것을 좋아합니다. 그래서 어느날 보수주의자들이 제 페이스북 피드에서 사라졌다는 것을 알았을 때 깜짝 놀랐습니다. 페이스북이 제가 어떤 링크를 클릭하는지 살펴보고 있었고, 그것은 실제로 제가 보수적 성향의 친구들보다 진보적 성향을 가진 친구들의 링크를 더 많이 클릭했다는 것을 나타내는 것이었죠. 그리고 제 의견을 묻지도 않고 페이스북은 그것을 편집해 버렸습니다. 그들은 사라졌죠.”

- 엘리 프레이저의 테드 강연 '온라인 ‘필터버블’을 주의하세요' 중

정보 홍수 속 맞춤 콘텐츠 추천 시스템 생겨나

구글, 페이스북, 트위터 등 테크 기반 기업들은 콘텐츠를 유통하는 플랫폼을 운영하고 있다. 인터넷은 어마어마한 정보의 홍수다. 개인의 소셜미디어도 정보량이 많다. 자주 사용하는 소셜미디어는 모든 친구의 소식을 확인할 수 없는 수준이다. 수백 명의 친구, 팔로잉하는 페이지 등등에서 각각 한두 개 정보만 생산해도 수백개다. 가뜩이나 조그만 모바일 화면에서는 표시되는 정보량도 적다.

이 상황에서 좋은 사용자 환경을 마련해주기 위해서 테크 기업들은 개인이 좋아하는 것, 개인이 자주 보는 것 위주로 보여주는 방법을 선택했다. 사용자가 어떤 콘텐츠를 소비했는지, 어디에 반응했는지, 좋아하는 주제는 무엇인지 파악하고 사용자가 좋아할 법한 콘텐츠 위주로 제공하는 방식이다.

광고도 마찬가지다. 단순 배너광고의 효과성에는 물음표가 잔뜩 찍혀 있다. X를 누르기 어렵게 만들어 우연히 클릭하게 한다고 광고의 목적이 달성되는 게 아니다. 결국에는 구매로 전환돼야 한다. 이런 맥락에서 광고를 제공하는 업체들은 사용자의 정보를 바탕으로 사용자가 관심을 가질만한 광고 콘텐츠를 내보낸다. 가방을 검색해봤다면 광고에도 가방을 추천해주는 식이다.

스마트폰은 지극히 개인적인 기기다. 과거에 PC 한 대를 가족끼리 돌려쓰던 시기는 예전에 지났다. 스마트폰에는 한 사람의 기록이 온전히 담겨 있기 때문에 더 최적화된 개인화가 가능하다. 이렇게 방대한 웹에서 스마트폰이라는 굉장히 가느다란 깔때기를 통해 나에게는 일부분의 정보만 도달된다.

개인의 고정관념과 편견 강화해

개인 맞춤형 콘텐츠 추천 시스템은 일견 좋아 보인다. 하지만 이는 좋아하는 음식만 섭취하는 것과 같다. 건강한 육체를 유지하려면 영양소를 골고루 섭취해야 한다. 마찬가지로 건강한 사고를 유지하기 위해서는 다양한 콘텐츠를 접해야 한다.

특히 이 개인 맞춤형 콘텐츠 추천 시스템에 뉴스 콘텐츠가 섞이면 생각지 않았던 부작용이 생긴다. 자기가 좋아하는 뉴스, 보고 싶은 뉴스만 보면 결국 정치·사회적인 문제에서 고정관념과 편견을 강화하는 계기가 된다. 강화된 고정관념과 편견은 좀 더 입맛에 맞는 게시물만 가지고 온다. 악영향이 강화되는 셈이다. 이렇게 되면 여론을 잘못 이해하게 될 뿐만 아니라, 전혀 잘못된 소식이 확산력을 가지게 되는 상황도 생긴다. 이 문제가 가장 극적으로 드러났던 것이 45대 미국 대통령 선거다.

필터버블은 미국 대선을 거치고 트럼프가 대통령으로 당선되면서 다시 부각됐다. 수많은 언론과 유권자들은 여론은 완전히 클린턴에 있는 줄 알았는데 현실은 트럼프의 손쉬운 승리로 끝났다. 인터넷의 여론과 현실을 전혀 달랐다. 여기에 ‘가짜 뉴스(Fake news)’ 논란까지 겹치면서 문제가 더 커졌다.

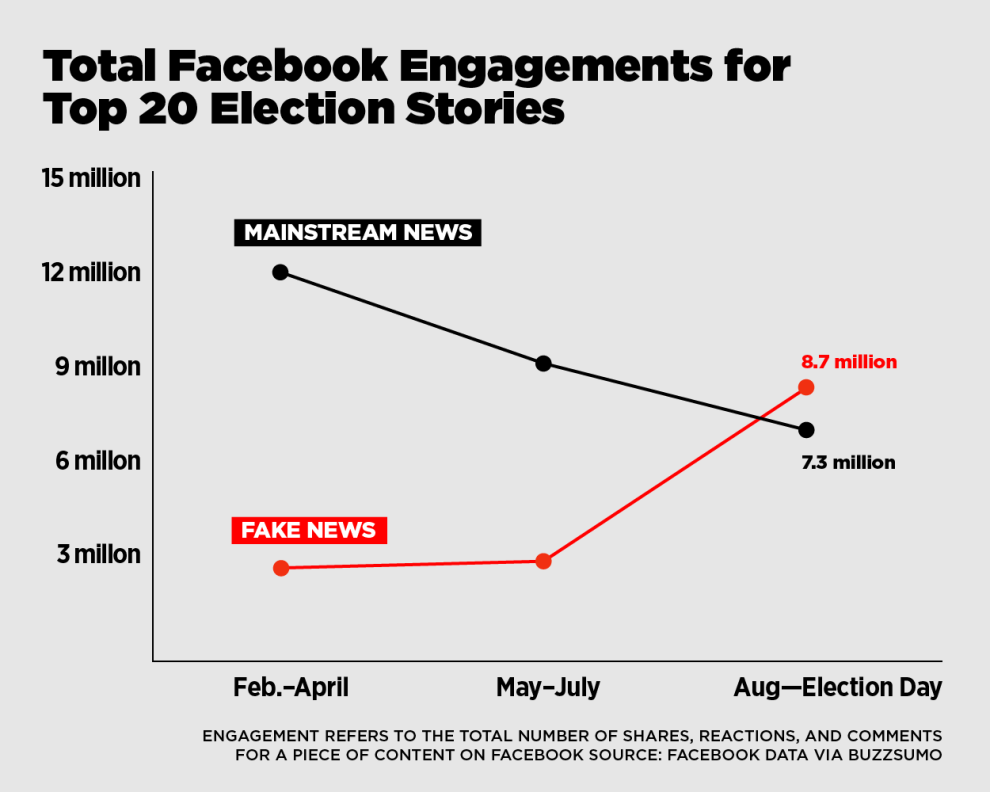

<버즈피드>가 2016년 11월 17일에 낸 분석 기사에 따르면(☞데이터 확인하기)미국 대선 전 3개월간 가장 인기 있었던 가짜뉴스 20개의 페이스북 내 공유, 반응, 댓글 수는 871만 1천건으로 <뉴욕타임스>, <워싱턴포스트> 등 주요 매체의 기사보다 더 많은 반응을 이끌어냈다. 특히 ‘프란체스코 교황이 트럼프 지지를 발표했다’거나 ‘클린턴 후보가 ISIS에 무기를 판매했다’는 식의 터무니없는 내용도 특정 성향을 가진 사람들이 좋은 소식이기 때문에 비슷한 성향의 그룹에서 빠르게 공유되고 확산력을 가진다.

이처럼 필터버블은 개인의 편견이나 고정관념만 강화하는 데 그치지 않는다. 필터버블은 사회와 정치에 악영향을 미쳐 궁극적으로 민주주의의 오작동에 기여한다. 테크 기업들이 적극적으로 해결책을 모색하지 않으면, 민주주의를 훼손하는 서비스라는 오명을 피할 수 없다. 메르켈 독일 총리는 “건강한 민주주의는 반대 의견을 얼마나 접하는가에 달렸다”라고 강조하며 필터버블 현상을 우려했다.

사회적인 논의로 필터버블을 극복해야 한다

페이스북은 2017년 1월 11일 ‘페이스북 저널리즘 프로젝트’를 시작한다고 밝혔다. 필터버블 논란을 정면으로 돌파하기 위한 시도다. 페이스북 저널리즘 프로젝트는 ▲뉴스 제품 공동 개발 ▲저널리스트를 위한 교육과 도구제공 ▲사용자를 위한 교육과 도구 제공으로 구성된다. 특히 사용자를 위한 교육과 도구 측면에서는 뉴스 읽기 능력(News literacy) 배양 및 가짜뉴스 억제 방안 등 필터버블을 해소하려는 방법에 집중하고 있다. 페이스북은 “우리 커뮤니티의 가치가 아이디어와 뉴스를 공유하고 토론하는 데 있는 것을 알고, 서비스의 일환으로 건전한 뉴스 생태계와 저널리즘이 번창할 수 있는 데 많은 관심을 기울이고 있다”라고 배경을 밝혔다.

페이스북은 필터버블과 가짜 뉴스 논란을 돌파하기 위해 ‘저널리즘’이라는 가치를 전면에 내세웠다. 동시에 뉴스 파트너들과 협력해 더 건강한 페이스북 환경을 만들겠다고 공언했다. 필터버블이라는 단어를 만든 엘리 프레이저는 “필터들을 통해서 결정하는 규칙이 어떤 것인지 볼 수 있을 만큼 충분히 투명한지 확실하게 할 필요가 있다”라고 강조한 바 있다. 필터버블의 문제는 기술의 영향력이 날로 증가하고 있는 현실에서 사회적인 논의를 통해 개선점을 찾아 나가야 한다.

※ 참고

- 온라인 "필터 버블"을 주의하세요, 테드

- 페이스북, ‘페이스북 저널리즘 프로젝트’ 런칭, <블로터>, 채반석

- This Analysis Shows How Fake Election News Stories Outperformed Real News On Facebook, <BuzzFeed>, Craig Silverman

이 글은 ‘네이버캐스트→테크놀로지월드→용어로 보는 IT’에도 게재됐습니다. ☞‘네이버캐스트’ 보기